「見落とし」と「高コスト」を同時に解消できるか——。

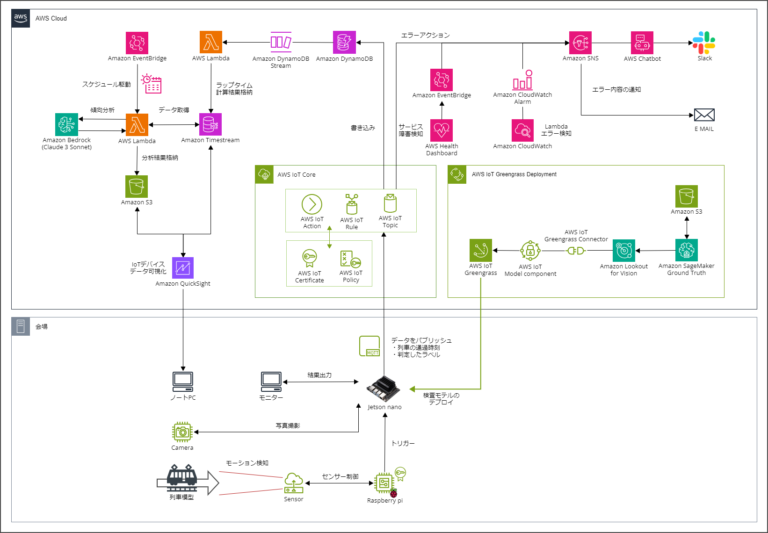

本記事では、Amazon Lookout for Visionを中心に、JetsonやRaspberry Piを活用したエッジコンピューティング構成で、外観異常検査をリアルタイムに行うデモ事例を紹介します。

ポイントは「なぜこの構成なのか」。クラウド推論ではなくエッジを選んだ理由、SageMakerではなくLookout for Visionを採用した背景、そして実際にハマったGreengrassの問題まで踏み込みます。センサー検知から撮影、推論、クラウド連携、可視化、生成AIによる傾向分析までを一気通貫で構築。目視では追いつかないラインでも“体感で遅延を感じない”リアルタイム判定を実現しつつ、数万円規模のデバイスでPoCを成立させた具体像がつかめます。

背景

このプロジェクトは、実際のお客様からのご相談をきっかけに始まりました。

お客様は工場のコンベアラインを流れる商品の異常(ラベル貼り忘れの有無等)を判定したいと考えていました。具体的には、目視確認ではミスが発生しやすく、これを自動化したいというニーズです。

ご提案にあたり、具体的な実現イメージをつかんでもらうために、列車模型を使ったデモを作成しました。

目的

お客様の課題を受けて、AWSの技術を活用して製造現場での人的リソースによる単調な目視検査を最適化することを目指しました。これにより、効率化とコスト削減を図ります。

ソリューション概要

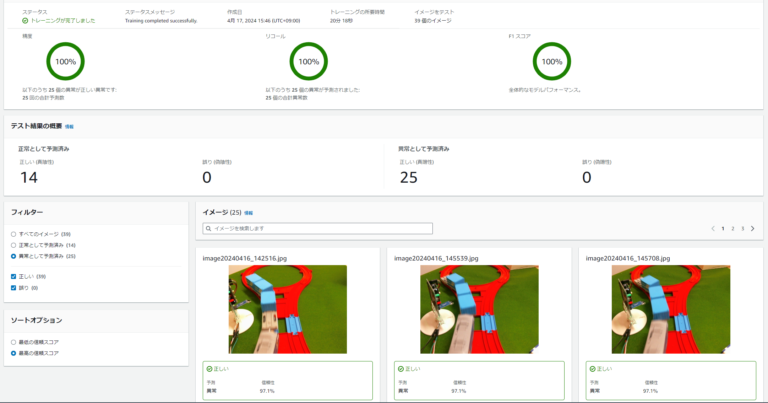

モデルのトレーニング

Amazon Lookout for Visionを用いて外観異常検査のためのモデルを構築します。トレーニングには検査対象となる実際の車両の写真を使用し、アノテーション作業を行うことで精度の高いモデルを作成します。具体的には、『Amazon SageMaker Ground Truth』を使用した、GUI上で異常範囲をマークするといった作業に加えて、モデルの精度向上のために、約数百枚のアノテーション作業を実施するため、社内で呼びかけ(緊急クエストの発令)を行い、プロジェクト外のメンバーも交えて実施しました。

センサー検知と写真撮影:

センサー検知と写真撮影

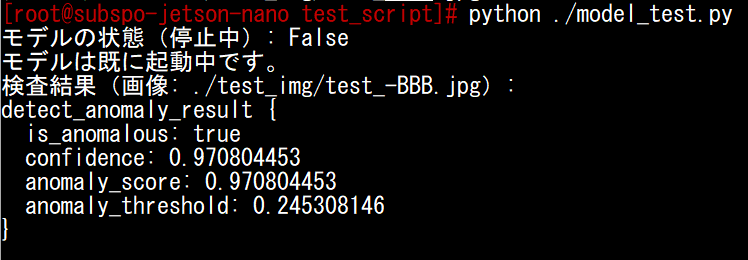

Raspberry Piにセンサーを接続し、対象物を検知。センサーが物体を検知することで、Jetsonに電気信号を送信するように設定を行い、検知した対象物を撮影します。その画像をLookout for Visionで解析し、異常検査を行います。

結果の出力とデータ送信:

判定結果

検査結果をリアルタイムで画面に表示し、AWS IoT Coreを通じて結果データをクラウドに送信します。具体的には、AWS IoT CoreへのMQTTプロトコル通信を用いてデータを送信しました。

データの蓄積と可視化:

データの蓄積と可視化

送信されたデータはAmazon Timestreamに保存され、Amazon QuickSightで可視化されます。さらに、Amazon Bedrockを利用して生成AIによる傾向分析を行います。具体的な分析手法としては、Amazon Timestreamに対して直近の蓄積データをクエリし、その結果に対する分析を行うようなプロンプトを設定したAWS Lambdaから、Amazon Bedrock(Claude)にリクエストを送信する方法を用いました。

技術スタック

導入のメリット

AWSのサービスを組み合わせることで、初期費用はエッジデバイス(マイコン、カメラ、センサー)のみで済み、最小限のコストで実現できました。また、今回の構成の大部分がサーバレスアーキテクチャであるため、固定費がほとんど発生せず、優れたスケーラビリティを持っています。

関連するFAQ

Q. Amazon Lookout for Visionはどんな用途に向いていますか?

A. 製品のキズ、欠品、ラベル不備など「正常と異常の見分け」が必要な外観検査に適しています。本事例でも数百枚規模の画像からモデルを構築しており、専門的なML実装なしでPoCに到達できる点が採用理由でした(SageMakerでのフルスクラッチ開発より立ち上がりが速い)。

Q. なぜエッジで推論する必要があるのですか?

A. コンベア上の検査では往復の通信遅延がボトルネックになります。本構成ではJetson上で推論を完結させることで、目視上ほぼ遅延を感じないレベル(1秒未満)で判定できました。高解像度画像をそのまま扱える点もクラウド推論との差です。

Q. Jetsonでの推論性能はどの程度ですか?

A. 本デモでは単一画像ごとに即時判定が返り、ライン上でも停止なしで処理できるスループットを確保できました。厳密なベンチマークは未取得ですが、「センサー検知→撮影→判定→画面表示」までが連続的に回り、実運用を想定した速度感を確認しています。

Q. なぜLookout for Vision×Greengrass×Jetsonの構成にしたのですか?

A. 判断軸は「立ち上がりの速さ」と「現場での遅延」です。Lookout for Visionで学習を簡素化し、Greengrassでエッジ配布を標準化、Jetsonで低遅延推論を実現しました。クラウド常時推論は遅延と通信量が課題、SageMaker中心構成は開発コストが上がるため、PoC段階ではこの組み合わせが最短でした。

Q. Greengrassで詰まったポイントは?

A. コアデバイス化やコンポーネントのバージョン依存で不具合に遭遇しました(当時は既知の問題で後に修正)。対策としては、事前に対応バージョンの組み合わせを固定すること、最小構成でデプロイ検証を行ってから機能追加することが重要です。

Q. 学習データはどの程度必要ですか?

A. 本事例では数百枚規模でアノテーションを実施しました。対象や要求精度に依存しますが、小規模データから検証を始め、誤検知パターンを追加学習で潰していく進め方が現実的です。

Q. クラウド連携と生成AIは何のために使っていますか?

A. IoT Core経由で集約した結果をTimestreamに蓄積し、QuickSightで可視化します。さらにBedrockを使うことで、SQLを書かずに「最近どの異常が増えているか」といった傾向を自然言語で要約でき、現場担当でも分析にアクセスしやすくなります。

まとめ

今回のプロジェクトは、実際のご相談をきっかけに少人数で発足した社内プロジェクトでしたが、クラウドの特性を活かしたスクラップ&ビルドの手法により、短期間で高品質な外観異常検査ツールを開発することができました。AWSの多彩なサービスを組み合わせることで、多くの課題を解決できることを改めて実感しました。